This post is also available in: English (영어) 繁體中文 (중국어 번체) 日本語 (일어)

인공지능(AI)이 보편화되면서 지금까지 고려되지 않았던 보안 문제가 발생하고 있습니다. AI-SPM(AI 보안 태세 관리)은 모델 위험, 데이터 노출, AI 환경 내 오용 가능성 등의 문제를 해결하는 새로운 기능 세트입니다.

보안 및 규정 준수 위험을 줄이는 동시에 AI 및 생성형 AI를 대규모로 배포하는 데 따른 고유한 과제를 해결하기 위해 Prisma® Cloud AI-SPM을 발표하게 된 것을 기쁘게 생각합니다.

AI-SPM으로 AI 위험 해결

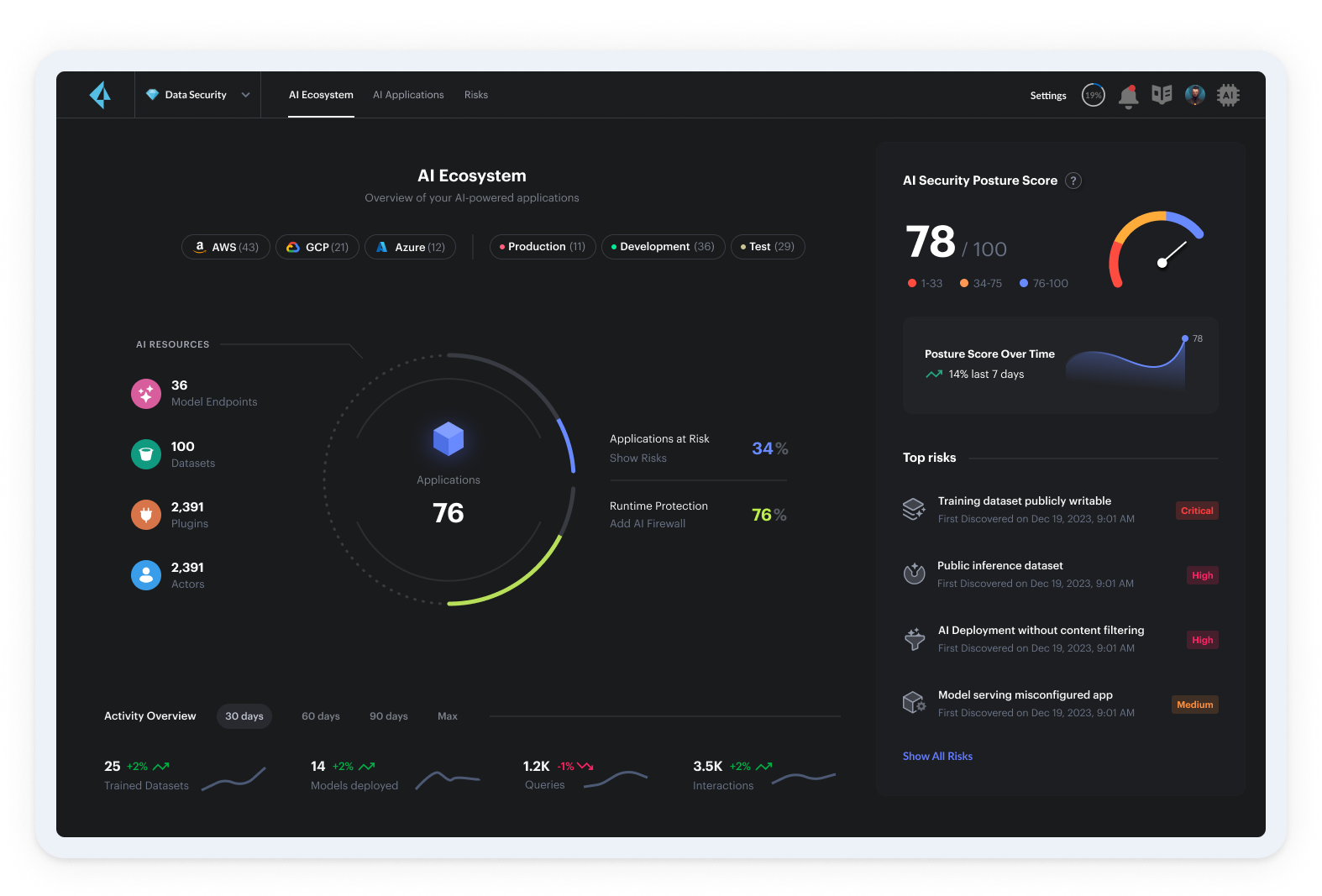

AI-SPM은 데이터 노출, 오용, 모델 취약성을 포함하여 AI, ML 및 생성형 AI 모델과 관련된 고유한 위험으로부터 조직을 보호할 수 있도록 설계된 새로운 도구 범주입니다. AI-SPM은 데이터 보안 태세 관리(DSPM), 클라우드 보안 태세 관리(CSPM), 클라우드 인프라 자격 관리(CIEM)와 같은 기존 보안 태세 관리 접근 방식의 요소를 채택하여 프로덕션 환경에 있는 AI 시스템의 특정 문제를 해결하도록 조정합니다. Palo Alto Networks®에서는 이를 Code to Cloud™ 접근 방식의 확장이자 통합된 부분으로 보고 있습니다.

AI-SPM 도구는 데이터 수집 및 훈련부터 배포까지 AI 모델 수명주기에 대한 가시성을 제공합니다. AI-SPM은 모델 동작, 데이터 흐름 및 시스템 상호 작용을 분석하여 기존 위험 분석 및 탐지 도구로는 명확하지 않을 수 있는 잠재적인 보안 및 규정 준수 위험을 식별하도록 도움을 줍니다. 조직은 이러한 분석 정보를 사용하여 정책과 모범 사례를 적용함으로써 AI 시스템이 안전하고 규정을 준수하는 방식으로 배포되도록 할 수 있습니다.

또한 AI-SPM은 데이터 오염, 모델 탈취 및 적절한 출력 처리와 같은 AI 관련 위협을 모니터링하여 보안 팀에 잠재적 인시던트에 대해 알리고 해결 단계에 대한 지침을 제공할 수 있습니다. AI 관련 규정이 계속 발전함에 따라 AI-SPM은 AI 개발 프로세스에 개인정보 보호 및 허용 가능한 사용 고려 사항을 포함시켜 조직이 규정 준수 요구 사항보다 앞서 나갈 수 있도록 도와줍니다.

AI-SPM의 핵심은 Palo Alto Networks의 독점 AI 시스템인 Precision AI입니다. 이 시스템은 풍부한 데이터와 보안 관련 모델을 사용하여 탐지, 예방 및 해결을 자동화함으로써 보안 팀이 AI 결과를 신뢰할 수 있도록 지원합니다. Palo Alto Networks의 Precision AI는 보안 팀이 AI 결과를 신뢰할 수 있도록 설계된 강력한 독점 AI 시스템입니다. Precision AI는 풍부한 데이터와 보안 관련 모델을 활용함으로써 탁월한 정확성으로 탐지, 예방, 해결 프로세스를 자동화합니다. Palo Alto Networks의 혁신적인 기술은 AI 기반 보안 솔루션의 중추 역할을 하여 오늘날의 복잡한 위협 환경에서 간소화된 노력과 안정적인 결과를 보장합니다.

AI-SPM의 주요 기능

광범위한 AI 생태계와 마찬가지로 AI 보안도 여전히 진화하고 있습니다. AI-SPM, 데이터 손실 방지 및 데이터 보안 사이의 경계가 항상 명확하지는 않습니다. 그러나 AI-SPM 솔루션의 몇 가지 필수 기능을 정의할 수 있습니다.

1. AI 모델 발견 및 인벤토리

필요한 이유: 조직의 여러 팀은 관리형, 반관리형, 비관리형 모델을 배포할 수 있습니다. 이로 인해 모델 확산, 무단 모델 사용, 거버넌스 부재, 섀도우 AI 위험이 발생합니다. 보안팀은 사용량을 효과적으로 모니터링하고 다운스트림 위험을 방지하기 위해 AI 배포 방식을 감독해야 합니다.

기능: AI-SPM 도구를 사용하면 조직 전체에 배포된 모델을 검색하고 관련 리소스(컴퓨팅, 데이터, 애플리케이션 포함)를 시각화하고 AI 파이프라인에 대한 포괄적 가시성을 확보할 수 있습니다. 이를 통해 잠재적인 위험을 식별하고, 거버넌스 정책을 시행하고, 승인된 모델만 프로덕션 환경에 배포되도록 할 수 있습니다.

샘플 시나리오: 내부 테스트의 일환으로 콘텐츠 가드레일이 없는 오픈 소스 LLM이 가상 머신에 배포되었습니다. 시간이 지남에 따라 민감한 사용 사례를 포함하여 이 모델의 사용이 일반화됩니다. AI-SPM 도구는 이 모델이 실행 중인지, 어떤 주체가 해당 모델에 액세스하는지 감지할 수 있습니다.

2. 데이터 노출 방지

필요한 이유: AI 모델, 특히 LLM은 민감한 정보, 개인 식별 정보(PII) 또는 기타 규제 대상 콘텐츠를 포함할 수 있는 방대한 양의 데이터로 훈련됩니다. 이는 의도치 않게 또는 훈련 데이터를 조작하여 모델에 편향이나 취약점을 도입하는 데이터 오염 공격으로 인해 발생할 수 있습니다. 타사 모델을 사용하면 이러한 위험이 모델 제공자에게 "아웃소싱"될 것으로 간주되지만, 조직의 자체 데이터가 미세 조정이나 추론에 사용되는 경우 이러한 위험이 다시 나타날 수 있습니다.

민감한 데이터가 모델의 일부가 되면 감지하기가 매우 어렵고("블랙박스" 문제로 돌아감) 일반적 모델 반응이나 프롬프트 인젝션 공격을 통해 잠재적으로 노출될 수 있습니다.

기능: AI-SPM 도구는 AI 추론 및 훈련 데이터를 위해 특별히 설계된 데이터 검색 및 분류 기능을 제공합니다. 이러한 도구는 보안 처리되지 않은 스토리지 버킷 또는 데이터베이스와 같이 노출된 데이터 리소스를 식별하고 잠재적인 데이터 유출 또는 무단 액세스에 대해 보안 팀에 경고할 수 있습니다. AI-SPM은 또한 데이터 흐름을 모니터링하여 중요한 정보가 실수로 AI 모델에 수집되거나 모델 출력을 통해 노출되지 않도록 할 수 있습니다.

샘플 시나리오: 연구원이 클라우드 스토리지 버킷을 사용하여 새로운 AI 모델에 대한 교육 데이터를 저장합니다. AI-SPM은 버킷에 고객 PII가 포함되어 있음을 발견합니다. 알림을 받은 보안팀이 연구원과 협력하여 데이터를 익명화하고 데이터 보호 규정을 준수할 수 있습니다.

3. 태세 및 위험 분석

필요한 이유: AI 시스템은 복잡하며 종종 데이터 파이프라인, 훈련 환경, 배포 인프라와 같은 여러 구성 요소를 포함합니다. 이러한 구성 요소의 구성이 잘못되었거나 액세스 제어가 취약하면 심각한 보안 위험이 발생할 수 있습니다. AI 모델은 적절하게 보호되지 않으면 프롬프트 인젝션, 추출 또는 서비스 거부 공격에 취약할 수도 있습니다. 마지막으로, 진화하는 규정을 준수하려면 AI 시스템에 대한 지속적인 모니터링과 평가가 필요합니다.

기능: AI-SPM 도구는 AI 시스템의 구성 및 액세스 제어를 분석하여 잠재적인 위험과 취약성을 식별합니다. 여기에는 앱 생태계의 데이터 세트, AI 배포 및 클라우드 리소스의 보안 태세를 평가하는 것이 포함됩니다. 또한 AI-SPM은 DSPM 도구와 통합되어 민감한 정보 흐름에 대한 상황별 데이터로 분석을 강화할 수 있으며, 이를 통해 감지된 취약점의 우선순위를 효과적으로 지정할 수 있습니다.

샘플 시나리오: AI 개발팀이 여러 고객 대면 모델과 내부 모델을 관리하고 있습니다. 애플리케이션 수준의 잘못된 구성으로 인해, 보호되는 지적 재산에 접근할 수 있는 내부 챗봇이 대중에게 공개됩니다. AI-SPM은 모델의 API 엔드포인트가 인증 없이 공개적으로 액세스 가능하고 모델이 보호된 데이터를 사용하고 있음을 감지합니다. 관련 개발팀이 알림을 받고 최소 권한 액세스 제어 및 인증 메커니즘을 구현할 수 있습니다.

Prisma Cloud AI-SPM 시작하기

프로덕션 환경에서 AI를 보호하는 것은 새로운 과제이며, 급변하는 위협 환경에 대처하기 위해 보안 팀이 과도한 노력을 기울이고 있는 시기에 발생하고 있습니다. 그러나 AI 도입과 AI가 조직에 제공하는 가치를 활용하는 시기를 늦추려는 생각이나 능력을 갖고 있는 보안 리더는 거의 없습니다.

Prisma® Cloud AI-SPM은 조직이 새로운 AI 모델과 도구를 도입할 때 필요한 가시성과 제어 기능을 제공합니다. Code to Cloud 플랫폼을 사용하면 Prisma Cloud의 기존 DSPM 및 CNAPP 기능을 기반으로 하는 긴밀하게 통합된 솔루션을 통해 보안 작업을 간소화하고 도구 팽창을 줄이며 가치 창출 시간을 단축할 수 있습니다.

AI-SPM이 필요한 이유를 알아보십시오. 데모 요청하기.